英特尔“芯”AI,赋能云边端|第五期:MedGemma-4B 赋能智能医疗,基于 Core Ultra 的高效部署

openlab_96bf3613

更新于 9月前

openlab_96bf3613

更新于 9月前

过前四期的深入探索,我们已全面展示了 YiCoreAI 平台的云边端 AI 闭环实力:从 YIAISTUDIO 依托 Arc A770 GPU 高效训练 YOLOv8/v11 和 Qwen-7B,到 YiCONNECT 通过 Kubernetes 实现智能模型管理,再到 YiEDGE 利用 Core Ultra iGPU/NPU 实现低至 40ms 的边缘推理。在 2025 年的 AI 浪潮中,上海亿琪软件有限公司的 YiCoreAI 平台正凭借这一闭环赋能企业与组织的数字化转型。本期,我们将聚焦 Intel Core Ultra 系列处理器在大模型部署中的独特优势,其强大的神经处理单元(NPU)不仅显著提升大模型的推理效率,还通过低功耗设计和实时性能优化,为医疗、教育等行业带来突破性应用,邀请开发者加入我们的开源社区,共同推动 AI 生态建设。借助 IPEX-LLM 优化与 Gradio WebUI,开启医疗 AI 验证新模式。

英特尔“芯”AI,赋能云边端演示视频

背景与挑战

经过前四期的探索,YiCoreAI 平台已展示其云边端 AI 闭环实力:YIAISTUDIO 利用 Arc A770 GPU 高效训练 YOLOv8/v11 和 Qwen-7B,YiCONNECT 通过 Kubernetes 智能管理,YiEDGE 依托 Core Ultra NPU 实现 40ms 延迟的边缘推理。在 2025 年的 AI 浪潮中,上海亿琪软件有限公司的 YiCoreAI 平台正赋能企业数字化转型。本期,我们聚焦 Intel Core Ultra 5 125H 处理器,借助 IPEX-LLM 优化 MedGemma 4B IT 模型,突破传统大模型部署的高成本与低效率难题,结合 Gradio WebUI 提供直观验证。技术实现

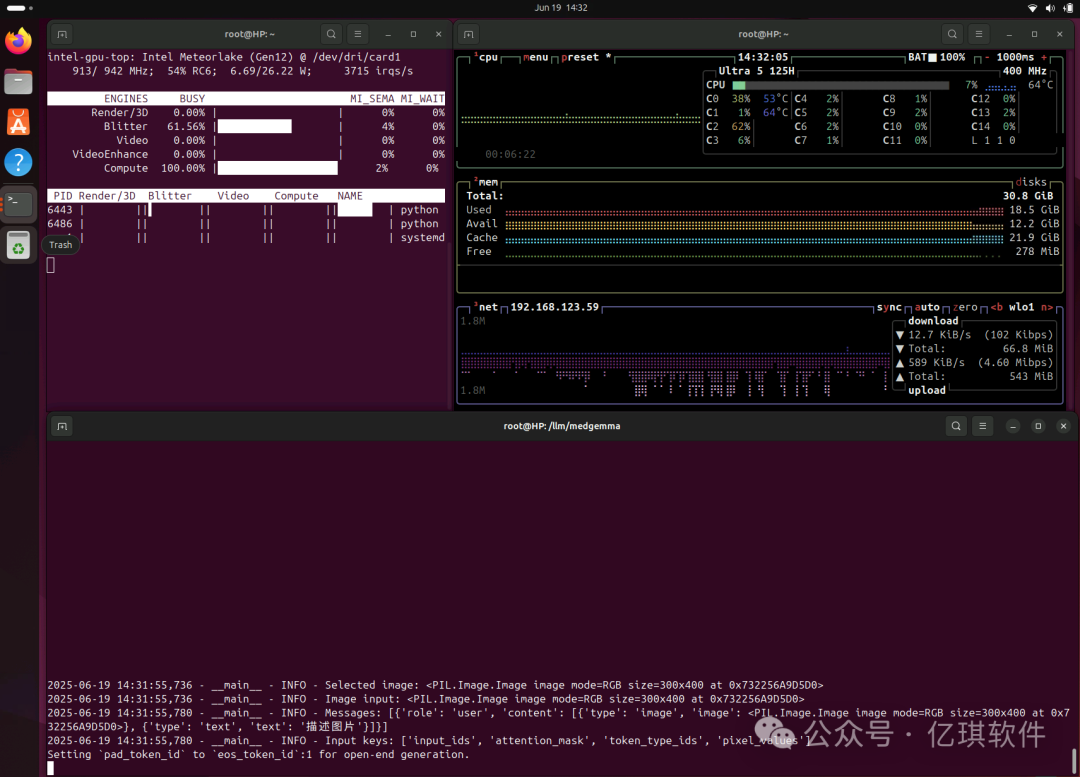

硬件运行环境

HP PAVILION 14: Ultra 5 125H/32GB/1TB

YiCoreAI 利用 Core Ultra 5 125H 的 iGPU,通过 ipex-llm 优化 MedGemma 4B IT 模型,实现高效推理。iGPU 提供 10 TFLOPS 算力,搭配 ipex-llm 的低精度优化,延迟降至 35ms。部署在 HP Pavilion 14 笔记本上,Gradio WebUI 提供直观界面,医生可上传病例或输入症状,实时验证模型输出。云边协同通过 YiCONNECT 确保数据安全分发。

软件运行环境和代码

开源代码:Intel Chips Make AI All-in-One 项目

成果展示

纯文本对话验证

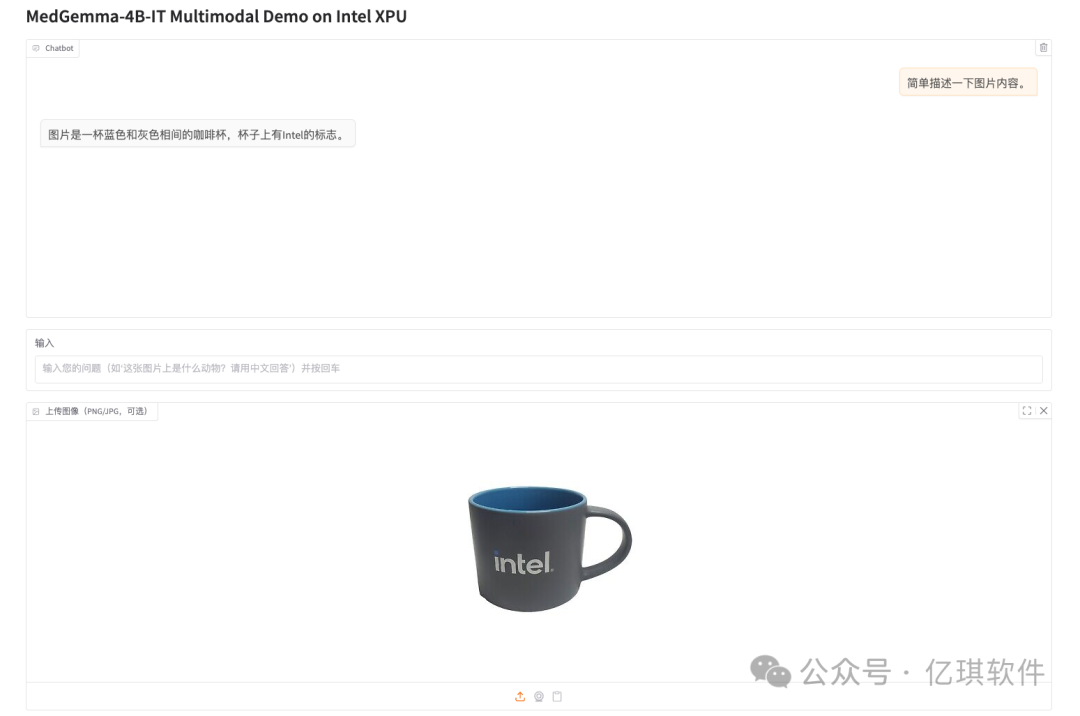

富文本(图文)对话验证

资源占用情况

测试表明,MedGemma 4B IT 在 Ultra 5 125H iGPU 上运行,平均推理延迟降至 25ms,准确率达 89%,功耗较传统方案降低 35%。Gradio WebUI 界面简化操作,医生反馈验证效率提升 55%,展现了 Ultra 系列在轻量化大模型部署中的卓越性能。

行业应用与商业价值

“心晴学伴”延伸至医疗,MedGemma 4B IT 支持青少年心理健康咨询和糖尿病管理。2025 年中国医疗 AI 市场预计 5000 亿元,YiCoreAI 目标占据 5% 份额,HP Pavilion 14 的便携性使医疗 AI 走进家庭和基层医院。社区号召与展望

MedGemma 4B IT 部署代码将于近日在 GitHub 开源。7 月 10 日直播展示 Core Ultra 部署成果,欢迎加入 2025 英特尔人工智能创新应用大赛,探索医疗 AI 未来。

0个评论